Régulation de l'IA : la Cnil et l'Arcom principaux interlocuteurs des collectivités

Le ministère de l'Économie a publié un projet d'organisation pour la régulation de l'IA imposé par le règlement européen sur l'intelligence artificielle. Pas moins de 20 entités sont mobilisées mais la Cnil et l'Arcom apparaissent comme les principaux interlocuteurs des collectivités territoriales. Sous réserve que le Parlement valide ce schéma.

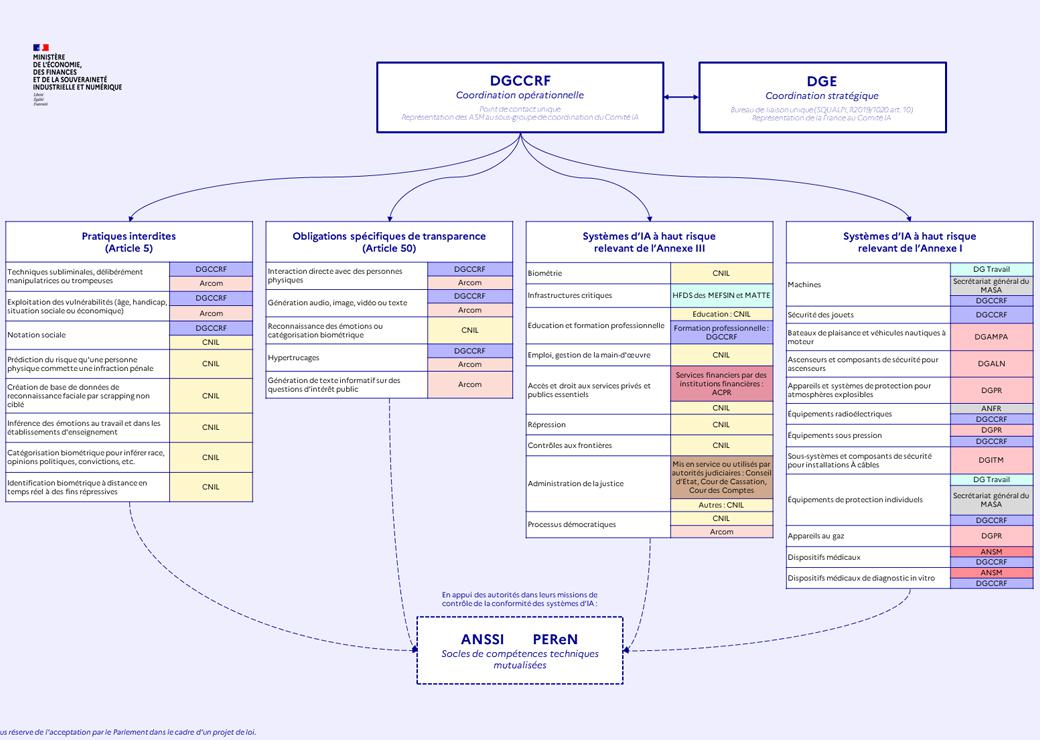

La France est en retard dans la désignation de l'entité nationale compétente pour mettre en œuvre localement le règlement européen sur l'intelligence artificielle. La direction générale des entreprise (DGE) et la direction générale de la concurrence, de la consommation et la répression des fraudes (DGCCRF) ont publié le 9 septembre 2025 un projet d'organisation. Pour réguler un domaine où s'entremêlent les enjeux économiques, sectoriels et sociétaux, l'État a opté pour une "approche décentralisée" selon le communiqué de Bercy.

20 entités impliquées

Avec pour conséquence l'implication de pas moins de 20 directions ministérielles, entités ou agences dans la régulation de l'IA selon le schéma publié par la DGE et la DGCCRF. C'est du reste la DGE qui hérite du rôle de point de contact et qui représentera la France au comité européen de l'IA. Son travail de coordination s'appuiera sur la DGCCRF pour le volet "opérationnel" avec un "support technique" de l'agence nationale pour la sécurité des systèmes d'information (Anssi) et du pôle d'expertise de la régulation numérique (Peren), mis à disposition de l'ensemble des entités mobilisées.

La répartition des régulateurs se fonde ensuite sur les grandes catégories d'IA listées par l'IA Act :

- IA interdites (article 5) ;

- IA soumises à des obligations de transparences (article 50) ;

- systèmes d'IA à haut risque relevant des annexes 1 et 3 du règlement.

Rôle central de la Cnil et de l'Arcom

Les principaux interlocuteurs des collectivités sur l'IA devraient cependant rester la Cnil et, dans une moindre mesure, l'Arcom. La Cnil doit ainsi veiller au respect des interdictions prévues par l'IA Act (notation sociale, détection des émotions, techniques subliminales…) et réguler les exceptions prévues à l'interdiction de la biométrie en temps réel dans l'espace public pour des fins sécuritaires. La Cnil surveillera aussi les usages des IA à haut risque dans le domaine de l'accès aux services publics essentiels, des processus démocratiques (avec l'Arcom), de l'éducation et de l'emploi.

L'Arcom, avec la DGCCRF, seront quant à elles chargées du contrôle des systèmes d'IA destinés à interagir directement avec des personnes, ceux qui génèrent des contenus de synthèse ou créent des hypertrucages. L'Arcom est par ailleurs chargée du contrôle des systèmes d'IA qui génèrent ou manipulent des textes publiés dans le but d'informer le public sur des questions d'intérêt public.

Briques manquantes

Cette architecture doit maintenant être validée par le Parlement par un projet de loi. Il devrait apporter un peu de clarté au "qui fait quoi sur l'IA" pour les acteurs publics, mais on soulignera que la régulation de l'IA dépend aussi de la finalisation du cadre européen. Or, si les lignes directrices applicables aux IA génératives en matière de transparence, de documentation et de gestion des risques ont été publiées le 18 juillet 2025, plusieurs briques font encore défaut. La Commission européenne a ainsi récemment lancé une consultation sur les moyens de rendre opérationnelle la transparence des systèmes d'intelligence artificielle (SIA), notamment pour informer les utilisateurs lorsqu'ils interagissent avec un SIA. Quant aux IA à haut risque, elles font encore l'objet d'arbitrages sur le périmètre d'application du règlement, l'entrée en vigueur des obligations n'étant pas attendue avant août 2026 (août 2027 pour les produits intégrant une IA à haut risque).