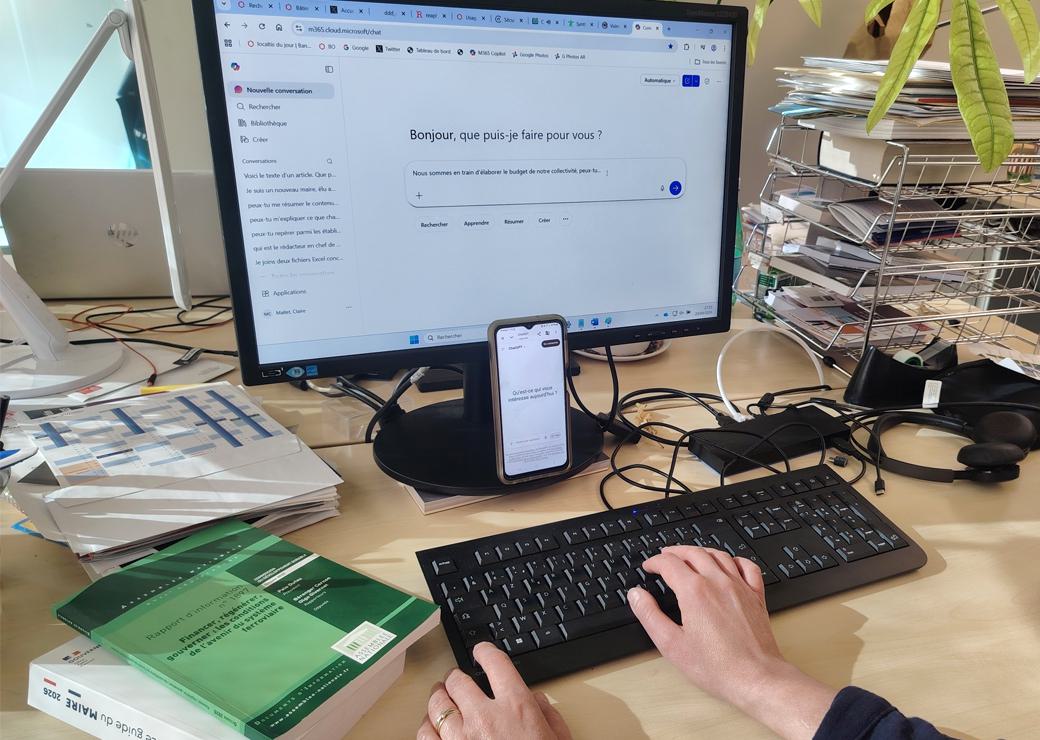

Usages clandestins de l'IA dans les collectivités : accompagner plutôt qu'interdire

Dans les collectivités comme en entreprise, l'usage professionnel de l'IA générative reste largement une pratique clandestine - le "shadow AI". Interdire s'avère cependant inefficace. Et si la mise à disposition d'un outil sécurisé est nécessaire, l'enjeu est surtout d'accompagner les pratiques pour en faire un levier de transformation numérique.

© AR

Selon le baromètre Ifop/Talan (2025), 43% des utilisateurs d'IA générative l'emploient dans un cadre professionnel mais seulement 9% disposent d'un outil fourni par leur employeur, 15% ayant reçu une formation. En d'autres termes, le "shadow AI" ou usage clandestin de l'IA dans les organisations prédomine largement.

Collaborateurs augmentés

Ce phénomène a fait l'objet d'une étude pilotée par l'Inria/Datacraft (juin 2025) qui a enquêté auprès de 14 structures parmi lesquelles deux collectivités, la région Île-de-France et la métropole de Montpellier. Le rapport documente ce phénomène de l'appropriation de l'IA en mode bricolage : rédaction d'e-mails, résumé, traduction, structuration d'idées, recherche documentaire, etc. Les collaborateurs agissent de manière autonome, souvent sans en parler à leur hiérarchie, par crainte d'être sanctionnés ou surchargés du fait de temps d'exécution plus rapide. L'étude note que les collaborateurs cherchent davantage l'augmentation de soi (efficacité, créativité, confiance) que la délégation pure à la machine.

Un phénomène qui s'élargit

Les usages se déploient sur un spectre allant "de la clandestinité individuelle jusqu'aux pratiques socialisées, en passant par des zones grises, usages informels, sécurisés ou tacites, qui traduisent autant de compromis entre ingéniosité des salariés et inachèvement des cadres officiels", relève l'étude. Et les plateformes d'IA ne sont pas seules en cause, de plus en plus d'applications proposant des fonctions d'IA plus ou moins explicites. C'est notamment le cas des outils de transcription intégrés aux plateformes de visioconférence. Or, une réunion interne a de fortes chances de traiter de sujets dont la fuite pourrait nuire à la collectivité.

Alerte sur l'IA agentique

Autre constat : le shadow AI s'est renouvelé en 2026, dépassant le simple usage de chatbots. Il est en effet désormais possible de connecter des applications et des données aux IA génératives. Ces "agents d'IA" sont capables d'exécuter des commandes, de lire et d'écrire des fichiers, d'envoyer des courriels ou de gérer des agendas. Si cette "agentification" n'est pas à la portée de tous, elle représente une nouvelle menace pour les organisations. Après le conseil national de l'IA (voir notre article), le Cert-FR (Anssi) s'est ému du sujet dans une note publiée le 13 avril. Le Cert alerte sur un risque "d'élargissement de la surface d'attaque" et de" perte de maitrise du système d'information". Dit autrement, les agents décuplent les problèmes du shadow AI – fuites de données, conformité réglementaire… – en donnant aux IA accès à des bases et applications métiers. L'Anssi recommande de proscrire leur déploiement en environnement de production, leur usage devant être strictement limité à des bacs à sable sans données sensibles.

Offrir une alternative crédible

L'interdiction pure et simple du shadow AI est cependant peu opérationnelle. C'est l'une des conclusions phares de l'étude de l'Inria. Les organisations qui ont bloqué ChatGPT, dont la Métropole de Montpellier, n'ont pas réduit les usages, elles les ont juste rendus invisibles.

Au-delà d'IA spécialisées sur un métier (juridique, marchés…), les collectivités doivent trouver une alternative crédible en matière d'IAG généraliste, accessible à tous les agents sur le poste de travail. Plusieurs collectivités, comme les départements des Alpes-Maritimes, du Gard ou le Nord ont fait le choix de Copilot, l'IA de Microsoft. Son principal mérite est d’être une IA totalement intégrée aux outils bureautiques existants, mais avec des incertitudes sur l'application des lois extraterritoriales. Face aux sénateurs, en juin dernier, le responsable des affaires juridiques de Microsoft n'a pas totalement levé le doute en déclarant ne pas être en mesure de "garantir" que les données d'administrations françaises, même hébergées en France, ne pourraient pas être transmises si l'administration américaine les exigeait.

IA souveraine

D'autres territoires font le choix d'IA européennes ou open source, hébergées sur des serveurs locaux, quitte à restreindre le périmètre d'usages. Rennes métropole teste un système conçu initialement par l'université de Rennes, baptisé RAGARenn, centré sur l'exploitation des données de la collectivité. Dans les projets structurants en matière d'IA "souveraine", on mentionnera aussi CmonIA, porté par l'Arnia, l'agence régionale du numérique de Bourgogne-Franche-Comté. Il s'agit d'un chatbot à vocation strictement professionnelle, utilisant différents modèles Mistral, hébergé dans un datacenter bourguignon. L'outil, présenté ici, cible d'abord les petites collectivités et est délibérément coupé du web pour garantir un usage maîtrisé. Il doit aider les secrétaires de mairie à gérer les tâches du quotidien (résumé, reformulation, structuration d'idées), permettre de mieux exploiter les données des communes et intégrer une logique de frugalité. Les modèles proposés sont associés à trois niveaux d'impact carbone illustrés par un vélo, un scooter et une voiture électrique. Le projet a suscité un fort intérêt du côté des opérateurs publics de services numériques (OPSN) du réseau Déclic, ouvrant des perspectives de mutualisation nationale.

Coconstruire les bonnes pratiques

Mettre un outil à disposition ne règle cependant pas tout. Il faut que les agents abandonnent les mauvaises pratiques et s'emparent des nouveaux outils. Le rapport de l'Inria appelle à "négocier collectivement la sortie du shadow AI", en parallèle d'un effort de formation massif et de la mise en place de chartes.

L'Inria insiste surtout sur la nécessaire co-construction des bonnes pratiques, de beaucoup préférables à des normes édictées par le haut. En Île-de-France, une "académie IA" a été mise en place, animée par une équipe interne. Elle fonctionne en groupes interservices d'une douzaine d'agents. Il s'agit d'espaces de partage où chacun montre ce qu'il fait déjà, apprend des pratiques des autres, et construit progressivement ses propres réflexes. L'Arnia, de son côté, insiste sur le fait que l'IA n'est pas un simple projet informatique mais doit être portée par le management et les élus. En parallèle de l'accompagnement des personnels municipaux, elle a entrepris de former massivement les élus.

Le Clusif propose une méthode pour reprendre la mainDans un petit guide publié en mars 2026, le Clusif propose aux responsables de la sécurité des systèmes d'information confrontés à une explosion du shadow IA une méthode en trois temps. Voir : réaliser l'inventaire complet des outils IA utilisés, mettre en place une veille dédiée sur le shadow IA/shadow IT, cartographier les usages et leurs propriétaires. Canaliser : identifier et référencer les solutions validées, les communiquer clairement aux agents, réviser les clauses contractuelles des fournisseurs IA existants. Contrôler : déployer une politique de sécurité IA, suivre l'utilisation réelle des outils, bloquer les usages clairement non autorisés - pas l'ensemble des outils -, contrôler les données transmises aux outils d'IA et les réponses obtenues. On notera la vision sécurité de ce guide, le rapport Inria insistant lui sur l'accompagnement pour éviter aux collaborateurs la tentation du contournement et construire des pratiques durables. |