Le Conseil de l'IA et du numérique incite à la plus grande prudence sur l'IA agentique

Pour ses premiers travaux, le Conseil de l'IA et du numérique, remplaçant du CNNum, s'est penché sur les agents d'IA. Une promesse d'automatisation de tâches complexes – qui intéresse aussi les collectivités - que le CIANum invite à prendre avec la plus grande prudence.

© Image générée à l'aide l'intelligence artificielle

Installé en juin 2025 en remplacement du Conseil national du numérique (CNNum), le Conseil de l'IA et du numérique (CIANum) est une instance consultative coprésidée par Anne Bouverot et Guillaume Poupard ayant pour mission d'éclairer les décisions publiques face aux transformations liées à l'IA. Pour ses premiers travaux le CIANum s'est penché sur les agents d'IA. Ceux-ci promettent de résoudre des problèmes complexes de manière autonome : planifier l'intégralité d'un déplacement, analyser et instruire une demande de subvention, gérer une procédure administrative de bout en bout … tout en minimisant l'intervention humaine.

De quoi parle-t-on ?

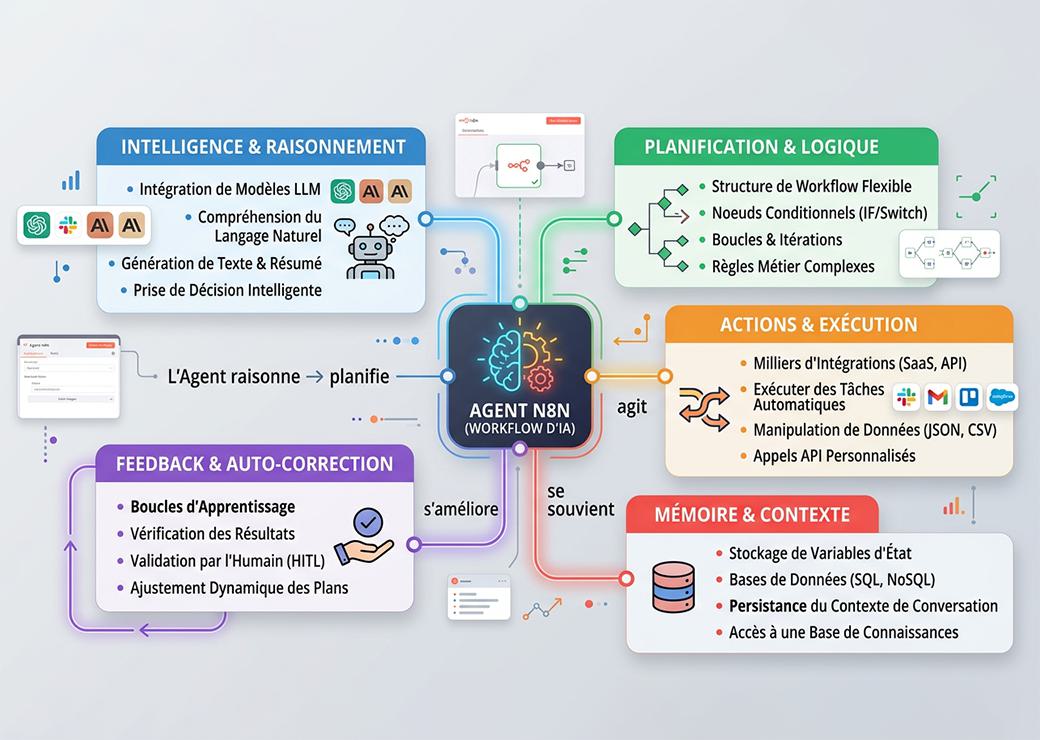

Dans une note d'une douzaine de pages publiée en février 2026, le CIANum entreprend de démystifier cette "vague agentique" en faisant la part entre le buzz, le fantasme du grand remplacement et la réalité technique. Le CIANum définit l'IA agentique comme un programme informatique capable de décomposer un processus, d'enchaîner des actions et de prendre des décisions en s'appuyant sur des modèles d'IA générative. Il préfère d'ailleurs ce terme à celui d'"agents IA", qui suggère une opposition binaire entre automatisation et contrôle humain. Car l'intervention humaine reste centrale : le degré d'autonomie de ces systèmes est variable, et le CIANum en identifie cinq, de la simple exécution de règles prédéfinies jusqu'à des flux semi-autonomes capables de décisions soumises à validation. Le cinquième niveau — une IA entièrement auto-dirigée — relève encore de la recherche.

On notera que cette démarche agentique, dans sa version semi-automatique, intéresse de plus en plus de collectivités .

Pas de rupture, mais une convergence

Pour le CIANum, l'IA agentique n'est pas une révolution technologique mais plutôt l'aboutissement de plusieurs avancées : modèles d'IA intégrant un processus de "raisonnement" apparus en septembre 2024, meilleure prise en compte par les modèles du "contexte" fourni par l'utilisateur et innovation logicielle. Par ailleurs, le CIANum fait état d'une baisse drastique des coûts d'inférence, divisés par 90 en 18 mois, autrement dit la phase de traitement d'une requête ou prompt.

Des erreurs amplifiées

C'est sur les limites que la note se montre la plus instructive. Sur le plan technique, les systèmes agentiques sont exposés à des effets en cascade : chaque étape d'un processus peut générer son lot d'erreurs, celles-ci finissant par se cumuler. Le CIANum identifie également des risques de "dérive de l'orchestration" lorsque plusieurs agents interagissent sans cadre commun, voire interprètent différemment une même consigne.

Se pose aussi la question de la responsabilité en cas d'erreur : qui est responsable d'une décision dommageable — le développeur du modèle, l'éditeur du logiciel, l'organisation qui le déploie ? La note relève un manque du règlement européen sur l'IA sur ce point. Celui-ci catégorise les systèmes d'IA selon leurs usages et niveaux de risque, mais ne fournit pas de cadre spécifique aux technologies agentiques.

Cybersécurité et environnement

Et au-delà de décisions potentiellement aberrantes ou dommageables, l'IA agentique présente de sérieux risques pour la cybersécurité. Ceux-ci sont amplifiés par la capacité de ces systèmes à interagir avec d'autres logiciels, faisant des agents des cibles idéales pour les attaquants. En outre, selon les experts cités par la note, ces agents seraient difficilement sécurisables…

Enfin, le CIANum alerte sur l'empreinte environnementale : selon l'Ademe, la généralisation des agents autonomes pourrait faire passer l'IA de 20% à 49% de la consommation totale des centres de données d'ici fin 2026.

Sur l'emploi, la note appelle en revanche à la prudence face aux annonces de suppressions massives. Il a été démontré que la pénétration de l'IA reste lente lorsqu'elle ne couvre qu'une faible part des tâches d'un métier. Le CIANum souligne aussi que l'IA agentique peut servir de prétexte à des licenciements économiques, et que le dialogue social doit jouer pleinement son rôle pour accompagner ces transformations.

L'intérêt des collectivités pour l'IA agentique

Les collectivités ne sont pas en reste sur l'IA agentique. Il s'agit cependant, au moins pour le moment, plus de "shadow IA" / d'exploration de la part d'agents (en chair et en os), que de véritables projets portés par la DSI de la collectivité. On peut distinguer deux approches.

La première consiste à exploiter les fonctions avancées des grandes plateformes d'IA : Claude, ChatGPT, Gemini, Perplexity ou Mistral. Il s'agit d'automatiser des processus simples, n'impliquant pas de données sensibles, comme le formatage de documents ou la recherche d'informations. Dans ce dernier cas, la veille est automatisée, des résumés sont générés et rassemblés dans une newsletter envoyée quotidiennement. Mais c'est plutôt une démarche mono IA, pré-agentique, c'est-à-dire sans enchaînement automatisé de tâches entre plusieurs outils.

Il y a ensuite des approches plus élaborées – que l'on peut qualifier d'agentification - qui cherchent à "orchestrer" et scénariser un processus appelant plusieurs outils, bases de données et où l'IA pourra remplir un formulaire, modifier une base de données, envoyer un mail… Plusieurs collectivités s'intéressent par exemple à n8n, une plateforme open source qui propose de multiples connecteurs et la conception de scenarios complets. Ces démarches, à suivre sur LinkedIn, sont à ce stade exploratoires et écartent clairement la relation usager en se concentrant sur le désilotage administratif. Eu égard aux risques mentionnés plus haut, on comprend pourquoi.